|

|

inviato il 13 Novembre 2024 ore 20:32

“ Ma per calcolo puro non bastano i tflops di cui è capace la scheda?

Semmai il dubbio è se il software sfrutta a fondo le unità di calcolo dedicato eventualmente presenti (penso ad esempio ai tensor core, di cui spunta una versione all'anno suppergiù). „

Se sono i dati forniti dalle case credo siano ottenuti con implementazioni ottimizzate: cuda per nvidia, rocm per amd, etc. Almeno, io fossi in loro farei cosi', di certo non userei opencl. In particolare quando si parla di accelereazione hardware per il training e l'inferenza AI, misurata in tops (tera operazioni/s, non necessariamente float)

Il motivo di usare cuda per nvidia è proprio quello che scrivi tu, spremere al massimo le performance dell'hardware. |

|

|

inviato il 13 Novembre 2024 ore 20:41

“ Ma per calcolo puro non bastano i tflops di cui è capace la scheda? „

onestamte non mi interesso più di programmazione grafica e schede da un po' ma in ogni caso tu devi vedere alla fine usando le librerie per gpgpu quali opencl o cuda quali sono i risultati specifici. Se i teraflop sono calcolati in altro modo non è detto che quando usi quelle librerie ottieni quelle performance anche per le ragioni che hai scritto dopo.

Purtroppo se guardi molti test di schede video non riportano altri test se non quelli dei videogame. per quello dico che eventualmente, in siti del genere, meglio guardare il raster puro |

|

|

inviato il 13 Novembre 2024 ore 20:45

“ Purtroppo se guardi molti test di schede video non riportano altri test se non quelli dei videogame. per quello dico che eventualmente, in siti del genere, meglio guardare il raster puro „

Vero, una volta era cosi'. Ora si cominciano a vedere anche misure delle performance AI, espresse in TOPS |

|

|

inviato il 13 Novembre 2024 ore 21:08

Perfetto, grazie Murphy. Questi sono i dati da guardare se uno è intenzionato ad usare le GPU come acceleratori hardware per l'AI.

Le prime in classifica, per videogames o fotoritocco non servono ovviamente a niente, otlre a costare (alcune di loro) svariate decine di migliaia di euro. Devices come le H200 è difficile che te le diano anche se arrivi con la valigetta piena di soldi, c'è una lista di attesa lunga e le big company del settore (google, amazon, tesla, etc) hanno la precedenza sui comuni mortali e su università e centri di ricerca medio-piccoli. Dove lavoro abbiamo una ventina di a200 e 4 h100, e abbiamo dovuto fare i salti mortali per riuscire ad averle

Comunque non volevo dare l'impressione di essere un difensore d'ufficio di cuda: funziona benissimo ma mi rode pure dovere usare un ambiente proprietario. Ho grande fiducia su rocm di amd, che è open: appena raggiunge cuda o gli si avvicina mollo cuda e vado su di lui |

|

|

inviato il 13 Novembre 2024 ore 21:17

“ Ma per calcolo puro non bastano i tflops di cui è capace la scheda? „

da quanto ho capito il calcolo dei tflops è fatto usando le unità di calcolo FP non i tensor cores, in un documento nVidia sull'architettura Turing (2080) ho trovato questi dati:

The GeForce RTX 2080 Ti Founders Edition GPU delivers the following exceptional computational performance:

14.2 TFLOPS1 of peak single precision (FP32) performance

28.5 TFLOPS1 of peak half precision (FP16) performance

113.8 Tensor TFLOPS

Comunque sw come DXO Photolab usano OpenCL solo in modo marginale, i calcoli del deep learning sono fatti con api specifiche che non conosco

Io ho una RTX 4070 Palit a 2 ventole, fa il suo dovere. Il sw Palit è molto spartano ma tanto serve a poco o niente |

|

|

inviato il 13 Novembre 2024 ore 21:20

Perché non hanno testato le AMD? O_o |

|

|

inviato il 13 Novembre 2024 ore 21:22

Tieni presente che per come sono fatte le GPU, le performance migliori si ottengono per operazioni su tipi di variabili ridotte: moltiplicare due float 32 bit e' più veloce di moltiplicare due float 64, se poi usi float 16 bit è ancora meglio.

Se vuoi il massimo devi approssimare i float con interi ("quantization")

Secondo me nella scheda che riporti hanno fatto casino e i 113.8 sono TOPS, non TFLOPS |

|

|

inviato il 13 Novembre 2024 ore 21:24

Questa è la scheda, ci sono anche TOPS, comunque è logico che i tensor cores siano più veloci, altrimenti avrebbero poco senso

developer.nvidia.com/blog/nvidia-turing-architecture-in-depth/

“ Each Tensor Core can perform up to 64 floating point fused multiply-add (FMA) operations per clock using FP16 inputs „ |

|

|

inviato il 13 Novembre 2024 ore 21:35

Ok, li' sono Tflops "accumulate", chissa' cosa vogliono dire. Ok, li' sono Tflops "accumulate", chissa' cosa vogliono dire.

E' interessante notare che le performance scalano in modo esttamente lineare con lo spazio di memoria delle variabili: float/interi a 32 bit vanno uguale, poi passando a float 16 bit, int 8 bit e int 4 bit si raddoppia ogni volta i teraflops/tops

Salto i dati accumulate che non so cosa a cosa si riferiscano.

In generale pero' conviene utilizzare fonti recenti perche' qui la tecnologia evolve alla velocità della luce

Mi fermo qui perchè sono un fanatico dell'argomento e dopo un po' divento pedante  |

|

|

inviato il 13 Novembre 2024 ore 22:00

“ li' sono Tflops "accumulate", chissa' cosa vogliono dire „

suppongo che sia l'operazione base di moltiplicazione e somma in un accumulatore. Quello che mi chiedo è cosa sono le TOPS, probabilmente la stessa cosa visto i prodotti di matrici sono sequenze di multiplicazioni e somme |

|

|

inviato il 15 Novembre 2024 ore 8:03

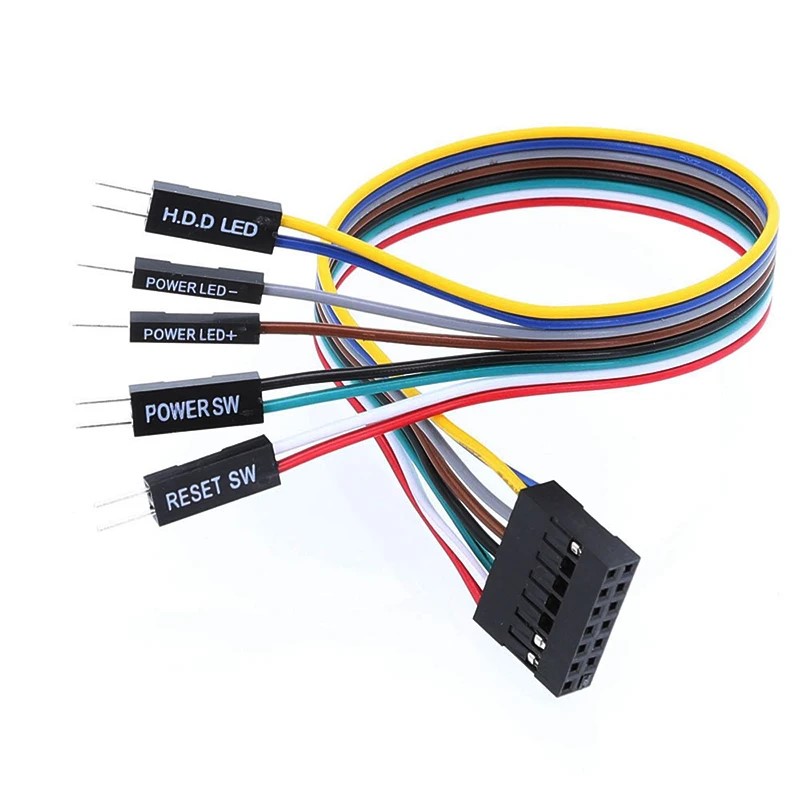

Case Antec D700 Flux arrivato. Bel case, finalmente si può fare il cable management.

Piuttosto, mi aspettavo che avessero risolto la storia dei mini-connettori per il tasto di accensione, reset, spia hdd ecc. mettendoli magari in un unico connettore. E invece siamo ancora così. Dovrò usare la lente di ingrandimento per riuscire a inserirli, oppure comprerò l'adattatore.

|

|

|

inviato il 15 Novembre 2024 ore 8:41

“ E invece siamo ancora così. „

Benvenuto nel fantastico club, di cui anche io faccio parte, delle bestemmie per azzeccare quei connettori.

E' stata la cosa più difficile dell'ultimo assemblaggio... XD |

Che cosa ne pensi di questo argomento?

Vuoi dire la tua? Per partecipare alla discussione iscriviti a JuzaPhoto, è semplice e gratuito!

Non solo: iscrivendoti potrai creare una tua pagina personale, pubblicare foto, ricevere commenti e sfruttare tutte le funzionalità di JuzaPhoto.

Con oltre 260000 iscritti, c'è spazio per tutti, dal principiante al professionista. |

Metti la tua pubblicità su JuzaPhoto (info) |

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.