|

|

inviato il 30 Ottobre 2018 ore 17:37

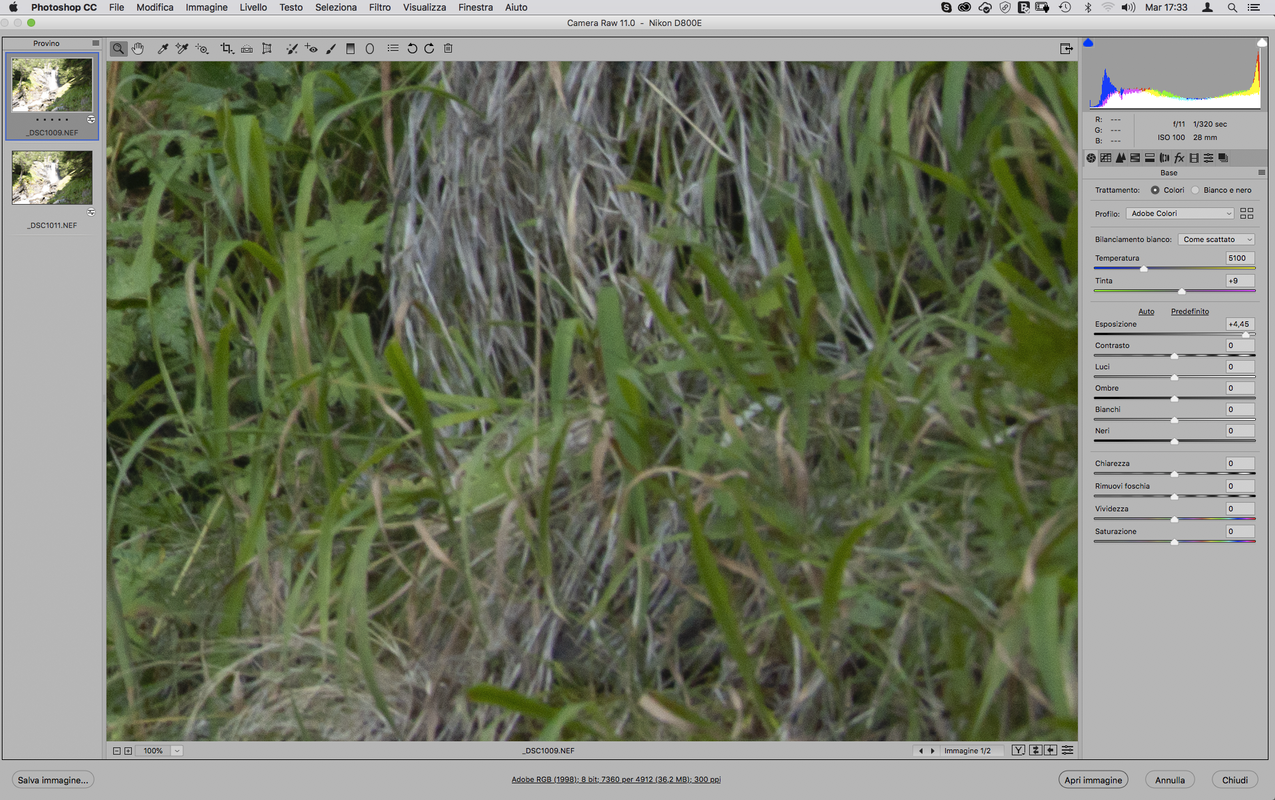

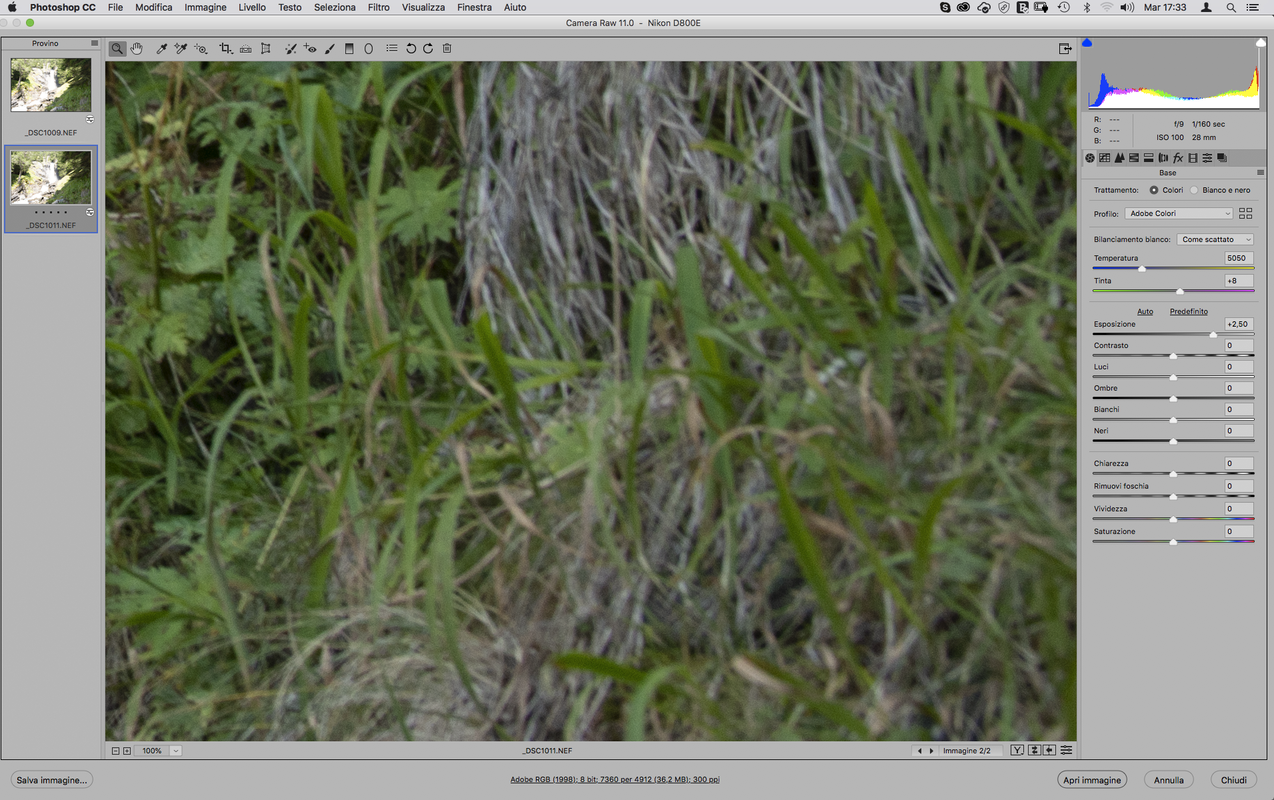

“ @Husqy

Perché non metti un ingrandimento del quadratino in basso a destra? Ben inteso: esposto al 18%

„ dici questo?

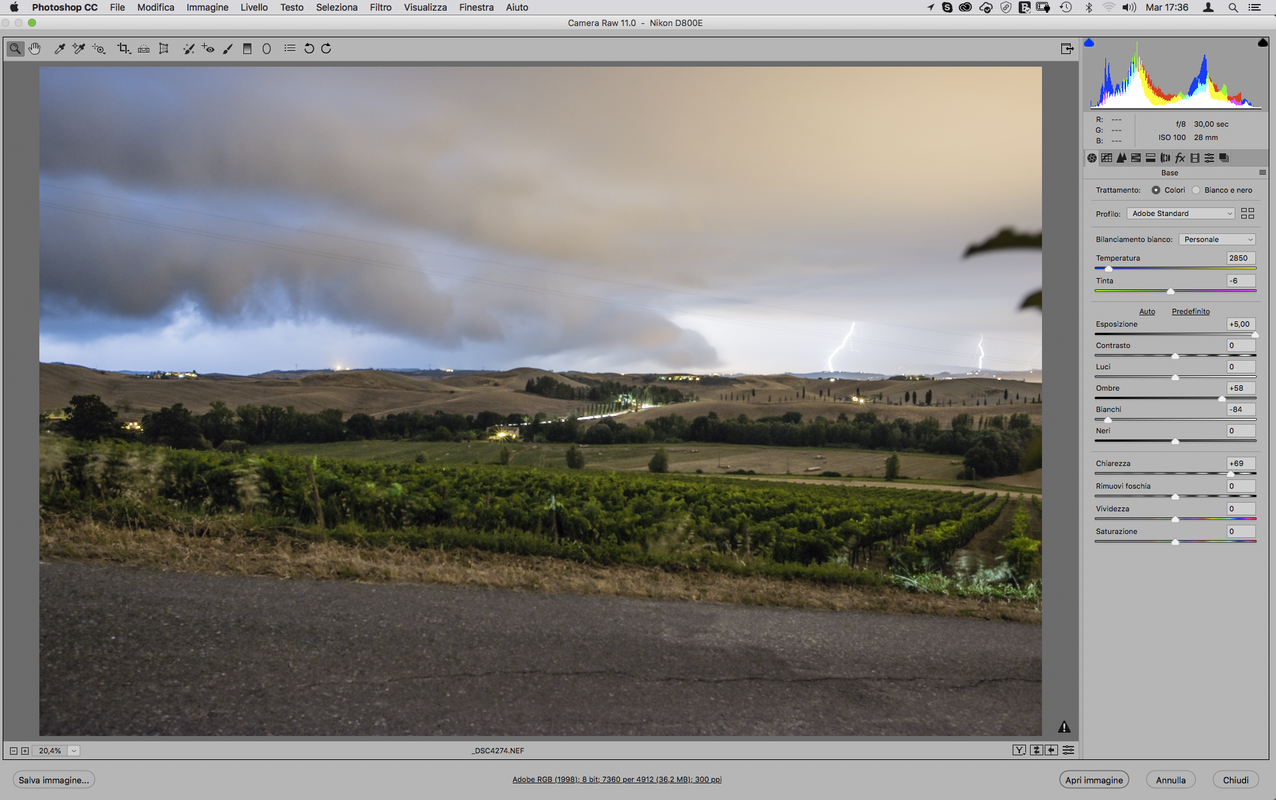

“ Intanto io sto ancora aspettando che qualcuno mi porti delle foto come l'esempio che facevo qualche messaggio fa: di notte, esponete per il lampione, la luna qualunque luce che volete e poi vediamo quanto di quello che sta intorno esce fuori „  un fulmine va bene come luce? un fulmine va bene come luce?

può bastare come esempio?  |

|

|

inviato il 30 Ottobre 2018 ore 17:38

Game over |

|

|

inviato il 30 Ottobre 2018 ore 18:04

@Husqy

Ora mi hai convinto   |

|

|

inviato il 30 Ottobre 2018 ore 18:08

“

"Esposizione corretta" è quella che ti propone la tua macchina, per definizione. In genere passa attraverso un cartoncino grigio col 18% di riflettanza. Ogni casa poi ha la sua filosofia, le prime Olympus lasciavano praterie a dx, più di 2 EV. Le regolazioni attuali riproducono un gatto nero e una lepre artica con lo stesso grigio medio. Non c'è niente di assoluto nelle regolazioni esposimetriche attuali.

„

Vi è anche da dire che tra modelli diversi di fotocamere, con sensori dalla gamma dinamica simile, a volte i sistemi di esposizione hanno logiche di funzionamento piuttosto diverse tra loro.

Vedasi il caso di 6d e 1dx: sulla prima il sistema di esposizione è in grado di riconoscere solo alcune tonalità di verde e rosso, mentre la seconda ha un sensore rgb molto più sofisticato, in grado di riconoscere anche eventuali volti presenti nella scena, e di regolare l'esposizione dando la priorità a questi ultimi, anche nella modalità valutativa.

All'atto pratico le differenze possono superare abbondantemente lo stop, tanto che si devono utilizzare impostazioni diverse anche a livello di compensazione dell'esposizione (in particolare in condizioni di forte controluce).

“

Anche ETTR non è assoluto. Fa felice il sensore, che ti restituisce tutto quello di cui è capace. Con l'esposizione in voga oggi questo non succede MAI. Non confondere il tuo senso estetico (molto più raffinato di un SNR) con la realtà strumentale. Si è portati a sottoesporre quando si capisce che la dinamica del sensore non è sufficiente, in un paesaggio meglio un ND sul cielo.

Insomma SNR=sqrt(n) dove n sono i fotoni raccolti. Se ne raccogli di più, sale SNR (ETTR). Se ne raccogli di meno cala SNR (sottoesposizione). Tutte le volte che SNR non è critico (=non vuoi leggere chiaramente i dettagli nelle ombre) ci sta di tutto.

„

Tra l'altro, oltre a migliorare il snr si sfruttano meglio i livelli di quantizzazione disponibili, esponendo a destra.

Così come si perdono fotoni, sottoesponendo una foto, al contempo si hanno meno livelli di quantizzazione per rappresentare le transizioni tonali, quando poi si vanno a sovraesporre le zone in ombra.

Ne è ben consapevole chi si occupa dell'ambito video, soprattutto con fotocamere/videocamere che registrano a 8bit: il limite, talvolta, non è la gamma dinamica del sensore, quanto lo scarso numero di livelli di quantizzazione, e conseguenti artefatti quando si sovraespongono oltre una certa soglia le zone in ombra (anche se parte del problema è dovuto al fatto di lavorare con un formato compresso).

Anche per questo, le "curve log" ottimizzate per fotocamere/videocamere che registrano video a 10bit non vengono implementate su quelle che si fermano a 8: vi sarebbero problemi di posterizzazione nelle zone in ombra, dato il numero di livelli di quantizzazione insufficiente.

Detto ciò, un elemento che talvolta si trascura è l'ottica. Giocando con l'apertura del diaframma, infatti, la vignettatura può divenire una sorta di filtro nd graduato, che in alcune situazioni torna utile: chiaramente si sacrifica la profondità di campo e, soprattutto con ottiche datate/particolari, il microcontrasto dell'ottica, ma se l'alternativa è avere una zona bianca senza dettagli, può convenire sperimentare (soprattutto se si lavora a distanza iperfocale). |

|

|

inviato il 30 Ottobre 2018 ore 18:24

Jack 96 : quando un fotografo con la xxxx incontra uno con la yyyyy.....etc etc  |

|

|

inviato il 30 Ottobre 2018 ore 18:34

per me vi fate troppi problemi alle volte è meglio sovraesporre anche più di uno stop alle volte è più favorevole sottoesporre anche più di uno stop. ogni contesto fotografico è a se la cosa importante è non bruciare le alte luci nei controluce tramonti albe e animali bianchi |

|

|

inviato il 30 Ottobre 2018 ore 18:58

Si va bene dire "a volte" ma resta il fatto che nelle parti chiare abbiamo tantissime informazione al contrario delle parti scure. Sapere questo e saperlo sfruttare non è un esercizio accademico ma una delle basi della fotografia digitale.

L'ho capito io che ho 10.000 dia in soffitta........... |

|

|

inviato il 30 Ottobre 2018 ore 21:21

@Hbd “ Tra l'altro, oltre a migliorare il snr si sfruttano meglio i livelli di quantizzazione disponibili, esponendo a destra. „ Questa era l'idea originale Reichmann-Knoll del 2003, uno era un fotografo, l'altro un programmatore. Sarebbe vero se nel segnale totale non ci fosse rumore. Ora a dx dell'istogramma il rumore è massimo. Facciamo che a 14 bit da 8k a 16k hai ben 8k gradini. Calcoliamo il rumore a 12k tanto per stare in mezzo all'intervallo: Noise=SNR=sqrt(12000)=109.5. Che te ne fai di gradini di 1 se hai in giro rumore medio oltre 100? Niente, a meno che il tuo scopo sia di calcolare il rumore in ogni pixel con accuratezza (caratterizzare il rumore non interessa a nessuno).

Questa bufala è stata diffusa per un po' di anni , poi è arrivato Emil Martinec (uno dei fisici teorici più in vista e appassionato di avifauna) che ha spiegato chiaramente come stavano le cose, senza intento polemico (2008).

È interessante seguire Martinec su DPReview gli anni prima del suo articolo, si vede come anche un fisico con una solida preparazione può avere dei dubbi. Ha chiesto umilmente lumi ai suoi pari e anche a normali forumisti DPR. L'articolo che inizia con "Noise..." è diventato un classico. È stato tolto dal server dell'Università di Chicago, poi nel 2015 Bill Claff ha rinfrescato i link e apportato lievi correzioni. Per parlare con cognizione di causa dei lati teorici della fotografia digitale è obbligatorio CAPIRE Martinec (leggerlo e basta non è abbastanza, bisogna capirlo). Siamo a livello del secondo anno di ingegneria, matematica, fisica, chimica. |

|

|

inviato il 30 Ottobre 2018 ore 22:11

“

Questa era l'idea originale Reichmann-Knoll del 2003, uno era un fotografo, l'altro un programmatore. Sarebbe vero se nel segnale totale non ci fosse rumore. Ora a dx dell'istogramma il rumore è massimo. Facciamo che a 14 bit da 8k a 16k hai ben 8k gradini. Calcoliamo il rumore a 12k tanto per stare in mezzo all'intervallo: Noise=SNR=sqrt(12000)=109.5. Che te ne fai di gradini di 1 se hai in giro rumore medio oltre 100? Niente, a meno che il tuo scopo sia di calcolare il rumore in ogni pixel con accuratezza (caratterizzare il rumore non interessa a nessuno).

„

Facevo riferimento alle zone in ombra (come indicato nella frase successiva), ovvero le tonalità tendenti al nero, visto che oramai va di moda sovraesporre di 5 stop le foto, in post produzione (qualche anno fa erano tre stop, ma visto che hanno ridotto il noise floor ora si è passati a 5).

Si veda anche il seguente esempio relativo a problemi di posterizzazione con la Sony a7rII, quando si spinge l'esposizione oltre certi limiti, in post produzione:

www.rawdigger.com/howtouse/sony-craw-arw2-posterization-detection

Per il resto, la questione di descrivere il rumore è interessante: mi chiedo se passare da 14 a 12 bit, al di sopra di una certa sensibilità iso, potrebbe portare qualche beneficio, in termini di rumore visibile.

Anzi, più in generale, mi chiedo il reale beneficio - con i sensori dell'epoca - del passaggio da 12 a 14bit di quantizzazione, effettuato dal 2007 da Canon su tutta la gamma reflex. Perché, visto che nelle zone in ombra (scarso numero di fotoni) il rumore è determinato primariamente dal "noise floor" del sensore, se quest'ultimo è tale da fare crollare il snr a livelli molto bassi, avere più livelli di quantizzazione non so a quali vantaggi possa portare. |

|

|

inviato il 30 Ottobre 2018 ore 23:11

Quanto a Martinec, il citato articolo si trova ancora sul server che ospita il suo sito accademico, anche se non è raggiungibile dalla sua homepage.

theory.uchicago.edu/~ejm/pix/20d/tests/noise/index.html

E' interessante, anche se si tratta di materiale non sottoposto ad alcun processo di peer review: in ogni caso, è senz'altro meglio dell'articolo tecnico medio che si trova su certi siti.

In effetti potrei provare a contattarlo, per valutare se abbia materiale più recente in merito alla questione. |

|

|

inviato il 31 Ottobre 2018 ore 2:02

@Hbd Martinec non compare su DPR da anni perché è attivo in ricerca. Intorno al 2007 Martinec fotografava Canon e fu colpito dalla Nikon D3 che aveva fatto il botto in FF. Non è un articolo accademico e quindi non si può parlare di peer review. Lui aveva sfruttato DPR dove effettivamente si aggiravano i più bei nomi del digitale. L'idolo di Ficofico (Jim Kasson) è un blogger molto attivo su DPR, ma ha una preparazione scientifica modesta. A Ficofico sembra un genio, a me un semplice "me too", d'altronde era stato onesto e aveva confessato i suoi limiti matematico-fisici.

In Italia abbiamo Marco Olivotto che è diventato il beniamino di Margulis, siamo ad alto livello anche se tende ad essere poco conciso.

A portare avanti discorsi à la Martinec è stato Hasinoff. Famoso un suo articolo in cui spiegava come in HDR alcuni scatti pagavano con ISO alti. Hasinoff ha fatto una rapida carriera ed è un capo di Google, che insieme a Intel è un po' la frontiera (AI) |

user92328

|

inviato il 31 Ottobre 2018 ore 3:59

“ io non vedo vantaggi, ne in rumore ne in colori migliori, non dico che ettr sia un errore, ma semplicemente che su certi sensori non serve „ Amen....

“ Valgrassi le disgessioni teoriche non m'interessano io mi affido ai risultati che vedo....come diceva Oscar Wilde : "i miei gusti sono molto semplici mi accontento di quello che c'é di meglio"...il risultato che ottengo mi và più che bene anzi mi sembra inesperato perché cercare il pelo nell'uovo io sono fotografo non ricercatore scientifico Sorriso..sfido chiunque a dire che queste minime differenze esporre a destra, ecc...siano rilevanti per ottenere una buona foto tecnicamente perfetta, „ Condivido pienamente.... gli strumenti adatti per misurazioni "millimetriche" vanno benissimo per chi lavora in laboratori di ricerca o simili, li ci stanno, ma per l'appassionato di fotografia conta tutt'altro, gli serve di andare a fare più foto e PP possibile, la cosi detta PRATICA, quella che ti fa sviluppare il buon gusto su ogni aspetto della fotografia a partire dalla compo in fase di scatto, alla gestione di luce e colore in PP... oppure, la ricerca creativa del cosa mettere davanti all'obiettivo, l'idea, la fantasia o il messaggio da sussurrare o come lo si vuole sussurrare.... insomma, tutti elementi che ti portano a fare arte fotografica e non ricerca scientifica o progettistica, quella è un'altra cosa...

C'è chi si ammazza a far fotografie vere e poi studiare la PP che si chiama ESPERIENZA VERA/CONCRETA, e poi c'è chi passa gli anni a fare prove sulla resa iso, resa dettaglio in tutte le salse e cose simili che si chiama, CURIOSARE e COMPARARE, che, in pratica è anni luce lontana dal discorso di ARTE FOTOGRAFICA.... |

user92328

|

inviato il 31 Ottobre 2018 ore 4:20

I grandi della fotografia, prendevano la migliore macchina del momento e andavano a lavorare sulle idee, sull'emozione o sul messaggio che una foto era in grado di portare in giro per il mondo... oppure davvero credete che si ponevano tutti questi quesiti microscopici...?? ma non credo proprio... e profondamente credo che lavoravano duramente affidandosi al proprio buon gusto sviluppato con anni ed anni di l'esperienza sul campo e non di certo facendo conversazione nei circoli dell'epoca o a far prove millimetriche.....

Veramente, certe volte nei forum si esce fuori dalla realtà, anche perchè molta gente pratica pochissimo la fotografia vera, e tantissimo il chiacchiericcio universale, preferendo infinite comparazioni di tetti e muri di case, finendo nel non essenziale, futile e inutile ai fini di un percorso di crescita personale...

Ma perchè non la finiamo di sconquassarci il cervello con tutti questi approfondimenti microscopici che lasciano il tempo che trovano, e fanno perdere tempo prezioso verso le cose che veramente contano.... |

|

|

inviato il 31 Ottobre 2018 ore 4:30

Molto interessante...seguo |

user92328

|

inviato il 31 Ottobre 2018 ore 4:43

Per quello che mi riguarda, tutto quello che i miei occhi non sono in grado di distinguere chiaramente ed in modo netto ed inequivocabile, per me lascia il tempo che trova....

insomma, piccole o lieve differenze che per vederle mi debbo mentre li a cercarle con molta attenzione, scusatemi, ma per me contano meno del nulla, perchè irrilevanti, perchè non incidono minimamente sulla resa finale della foto, anche se visionata al 100%......

Ma poi, ci rendiamo conto che, anche se facessimo una mostra a livello mondiale, dove sta il problema al momento in cui ad occhio nudo nessuno riesce a cogliere un problemino che magari a 200% riusciamo a vedere..??

Cioè, ma di cosa stiamo parlando...???

Ma su quale canale siamo, o che film stiamo vedendo...???  non ho parole, veramente.... non ho parole, veramente....

|

Che cosa ne pensi di questo argomento?

Vuoi dire la tua? Per partecipare alla discussione iscriviti a JuzaPhoto, è semplice e gratuito!

Non solo: iscrivendoti potrai creare una tua pagina personale, pubblicare foto, ricevere commenti e sfruttare tutte le funzionalità di JuzaPhoto.

Con oltre 260000 iscritti, c'è spazio per tutti, dal principiante al professionista. |

Metti la tua pubblicità su JuzaPhoto (info) |

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.