user86191

|

inviato il 19 Gennaio 2018 ore 13:13

Lore mi sono già perso al secondo punto

ma grazie per lo sforzo

|

|

|

inviato il 19 Gennaio 2018 ore 13:19

Scusate tanto, ma qui stiamo confondendo le capre e i cavoli, come ha detto il buon Raamiel.

Da Wikipedia:

“ Lo scopo pratico dei profili ICC è quello di consentire l'applicazione di un processo di gestione del colore che preservi i colori nel passaggio da uno spazio colore sorgente a uno spazio colore destinazione (per esempio, dallo spazio colore di una determinata fotocamera a quello di una determinata stampante). Il procedimento richiede due profili ICC, uno per la sorgente e uno per la destinazione; il primo viene usato per tradurre dallo spazio colore sorgente al PCS, e il secondo dal PCS allo spazio colore destinazione. „

In altre parole e' una trasformazione di uno spazio in un altro.

NON E' la misura di uno spazio, tanto meno in questo caso.

Potrei scriverlo a formule, pero' cerco di non farlo e di usare una metafora.

Prendi un cubo di lato 10 e una sfera di raggio 10.

Supponiamo di voler mappare ogni punto del cubo in un punto della sfera.

Il volume della sfera e' piu' grande del volume del cubo di almeno 4 volte, per cui la mia trasformazione dovra' in qualche modo "espandere" il mio cubo.

Ora, prendiamo il sensore (cubo) e lo spazio di destinazione (sfera).

Il profilo ICC fa passare dal sensore allo spazio di destinazione.

Per semplicita' nostra mostriamo l'ICC come uno spazio 3D, ma nel caso della caratterizzazione fa questo.

A dirla tutta, quindi, dato che l'espansione e' maggiore nel caso della 5DIV dispetto alla D850, se ne potrebbe dedurre l'esatto contrario, cioe' che c'e' piu' bisogno di "stretching" per la prima che per la seconda. |

|

|

inviato il 19 Gennaio 2018 ore 13:28

Il discorso non ha completamente senso secondo me.

Stiamo dicendo che il sensore della nikon D810 (ipotizziamo sia vero quello che dice Pollastrini), non sarebbe capace di registrare gli stessi colori del sensore della 5DIV.

Se questo è vero io dovrei avere dei colori che non vengono registrati dalla D810, dei colori fuori gamut, come avviene ad esempio per le stampanti.

Adesso, se fotografo una tazza del colore X, colore fuori gamut per la D810 dovrei avere un buco nella foto, come faccio a vedere la tazza se il suo colore è fuori gamut e quindi non viene visto dal sensore?

Qualcuno potrebbe dire, bene, il colore non è proprio lo stesso, è stato convertito ad un colore che il sensore può vedere.

Sbagliato, non è possibile neanche questo, se il sensore non vede quel colore come fa a convertirlo? Se lo vede perchè non dovrebbe registrarlo uguale? Ormai l'ha visto....

Questa è l'idea che mi sono fatto leggendo 30 secondi su google, a me come risposta basta e la trovo tutto sommato sensata.

Se poi Pollastrini posta una foto di un oggetto che ha un colore fuori gamut che non si vede nella foto, tipo la foto di un vampiro, allora ok, sono pronto a cambiare idea. |

|

|

inviato il 19 Gennaio 2018 ore 13:42

“ Se lo vede perchè non dovrebbe registrarlo uguale? „

Magari perchè non c'è l'ha nel suo gamut disponibile ed utilizza un suo alias già prestabilito.

|

|

|

inviato il 19 Gennaio 2018 ore 13:56

“ Magari perchè non c'è l'ha nel suo gamut disponibile ed utilizza un suo alias già prestabilito. „

Ok, allora attendo la foto di un colore che una D810 non vede |

user3834

|

inviato il 19 Gennaio 2018 ore 13:59

Auguri!  |

|

|

inviato il 19 Gennaio 2018 ore 14:04

"Ok, allora attendo la foto di un colore che una D810 non vede"

Arcanoid82

Non vedrai mai una foto come quella che chiedi neanche con un ipotetico monitor che ti fa vedere il 100% dello spazio colore ProPhoto RGB |

|

|

inviato il 19 Gennaio 2018 ore 14:16

Oddio... provo a spiegarlo di nuovo.

I sensori non hanno un gamut; non è possibile definirne uno.

Nessun laboratorio vi darà mai tale misurazione perché è priva di senso.

Un sensore ha una risposta anche nello spettro che noi non vediamo, quindi "vede" oltre il nostro locus; già questo rende assai difficile una valutazione sul gamut. Si passa infatti dall'ambito della radiometria e quello della colorimetria.

Di un sensore posso derivare in laboratorio le funzioni spettrali, ma non si può definire con precisione l'estensione del gamut.

Ora vediamo il caso più elementare di caratterizzazione di un sensore :

Per farlo sfruttiamo un target da fotografare, di cui conosciamo i valori colorimetrici o meglio ancora le misure spettrali.

Tipicamente è un ColorChecker, magari un SG che è più esteso oppure altri target più o meno complessi o più o meno costosi. La cosa che accomuna tutti questi target è la necessità di fabbricarli; vanno in qualche modo stampati e gli inchiostri o le vernici in nostro possesso hanno dei limiti di estensione.

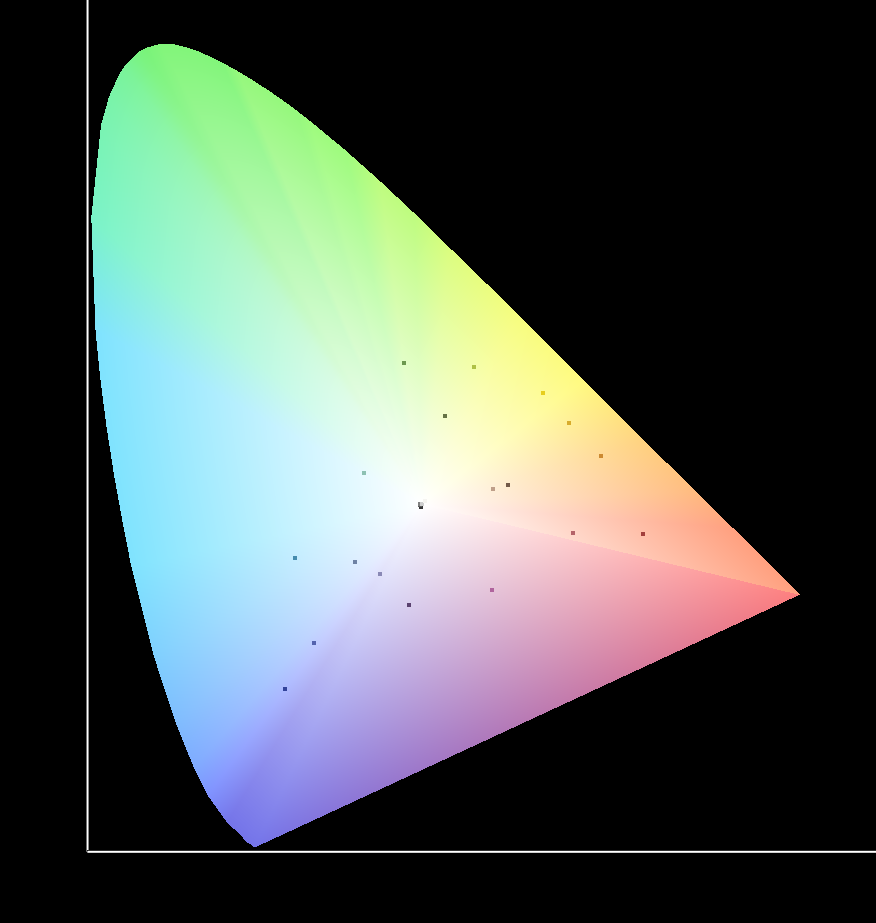

Vi faccio vedere il ColorChecker 24 classico :

potete vedere come le patch colorate del ColorChecker non si estendano poi molto; specialmente nelle zone dei verdi brillanti e degli azzurri. Questo perché è oggettivamente molto complesso stampare dei target stabili che arrivino a quelle zone.

Solo una delle patch sconfina oltre il piccolo sRGB :

Quindi possiamo ricavare dei dati, dei punti certi, solo da una zona piuttosto ristretta; mentre il potenziale gamut del sensore va oltre il locus umano.

Questo target va fotografato sotto un preciso illuminante noto; quello per cui il profilo sarà valido. Mettiamo un D50, poi va acquisto il raw, demosaicizzato ed effettuato il WB. A questo punto abbiamo l'immagine ricomposta e bilanciata del target in dati lineari RGB device dipendent.

Adesso bisogna tradurre questi numeri, caratterizzarli, per poter avere i dati scene referred.

La cosa più semplice è una matrice, una trasformazione lineare tra due spazi vettoriali, RGB device dipendent e XYZ. La matrice è qualcosa del tipo :

CIE X = R * n + G * n + B * n

CIE Y = R * n + G * n + B * n

CIE Z = R * n + G * n + B * n

L'algoritmo del software di profilazione deve trovare quei 9 numeri magici, tali che tutte le patch del ColorChecker possano essere tradotte al loro valore previsto.

Ci sono in questo caso 18 patch colorate che costituiscono i cardini su cui la matrice deve funzionare, o per meglio dire, produrre il minor errore possibile.

La priorità dell'algoritmo è il minimo errore sulle patch del campione fotografato, che però esplorano solo una parte centrale del locus. Si accetta quindi che la matrice prodotta sia in sostanza una speculazione e forzatura, precisa sulla parte centrale del locus (dove abbiamo dati di riferimento) e speculativa nelle aree estreme.

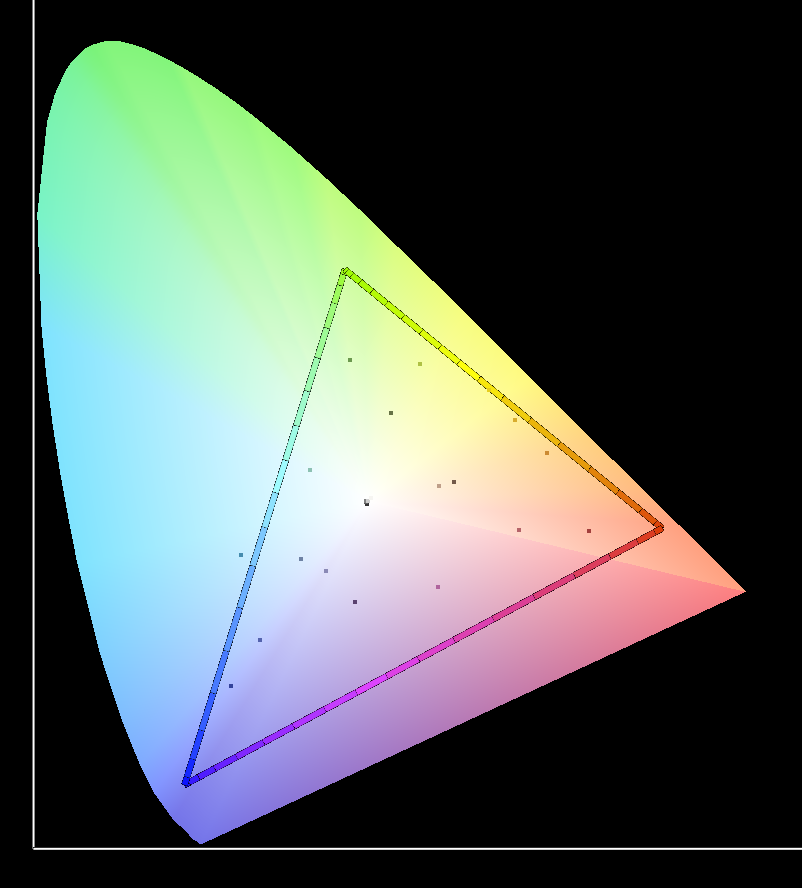

Siccome si tratta di una matrice 3x3 la sua forma è quella di un triangolo nella proiezione xy; i vertici di questo triangolo vengono posizionati per soddisfare l'algoritmo. Spesso e volentieri tali vertici divengono assai estremi, addirittura oltre il dominio di XYZ, dove il modello non ha più un significato coerente.

Potremmo plottare questa matrice e identificarla con il gamut del sensore, ma sarebbe un errore. La matrice potrebbe inglobare aree estranee alla risposta spettrale del sensore e lasciarne scoperte altre.

Algoritmi diversi arriverebbero a matrici diverse partendo dagli stessi dati.

E fino a questo punto abbiamo la semplice traduzione di dati device dipendent a dati scene referred.

Il prossimo passo sarebbe l'inserimento di una trasformazione Von Kries per l'adattamento cromatico dell'illuminante usato per fotografare il target verso il D50 del PCS.

Quindi prendiamo la matrice di prima e la moltiplichiamo per la CAT che vogliamo ottenendo una nuova matrice 3x3. Quale CAT usiamo però? Ce ne sono molte e nessuna è perfetta; Adobe usa la Bradford, Cobalt ne usa una diversa (più efficiente), ma in ogni caso la matrice iniziale, che è già una speculazione per gran parte della sua estensione, viene perturbata da un altro elemento che si porta dietro una parte aleatoria.

Passo successivo; l'inferno dei domini negativi.

Qui sono i cazzi più acidi....per farla breve basti dire che il modello CIE 1931 (cioè quello alla base di XYZ) presentava delle difficoltà tecniche per il periodo (il 1931 appunto) che lo rendevano piuttosto ostico.

Dal modello statistico emergeva il fatto che le curve di risposta sensoriali contemplassero domini negativi; ma al tempo, senza computer, smazzarsi matrici con elementi negativi era tedioso e fu imposto un modello corretto dove XYZ ha dominio nei reali positivi.

Quando però ci si trova a costruire un CFA (il filtro colore) ci si scontra con la realtà fisica; se vogliamo un CFA buono, allora anch'esso avrà delle curve di risposta negative e la matrice di caratterizzazione ne dovrà tener conto.

Ma.... XYZ è solo positivo; quindi praticamente tutte le matrici di caratterizzazione clippano nelle aree estreme producendo valori XYZ che sono al di fuori del modello standard... panico.

I profili ICC devono essere attinenti al modello CIE, quindi viene sempre implementata una strategia di contenimento di questi domini negativi; più o meno complessa o furba. Ma in ogni caso c'è e modifica ulteriormente il gamut plottato del profilo.

Ulteriore passo, la compressione della dinamica.

Praticamente tutti i profili usati nei convertitori RAW non sono colorimetrici e non sono lineari. Si aggiunge una curva di contrasto per mappare la dinamica scene referred in output referred. (i profili Cobalt Repro sono lineari)

Ancora.... al profilo viene aggiunto un gamut compression.

Siccome il potenziale gamut di un sensore moderno è assai più grande del gamut di una periferica di riproduzione (monitor, proiettore, stampante), praticamente tutti i profili in qualche modo comprimono il gamut per farlo rientrare meglio nelle capacità di tali periferiche.

Anche qui si tratta di come e quanto, software diversi propongono scelte diverse e anche le società come Adobe o PhaseOne hanno cambiato metodo nel tempo, adattandosi alle richieste ed ai gusti della clientela, nonché all'evoluzione delle periferiche di output; oggi si comprime meno di 5 o 6 anni fa perché la diffusione dei monitor wide-gamut è sempre più massiccia.

Ultimo, ma non meno importante, la color correction.

Quasi nessun profilo è seccamente colorimetrico, viene sempre aggiunta una parte di color correction che è aleatoria e mira a produrre (o riprodurre) un certo look.

La tendenza a pompare sui rossi delle Canon è una color correction stabilita a tavolino, non dipende dai sensori. Allo stesso modo il mood Nikon, Sony, Fuji, ecc... sono tutte delle color correction artificiali infilate nei profili.

Adobe cerca sempre di replicare questi mood per dare al cliente quello a cui è abituato con il suo marchio.

Scelte stilistiche e di marketing che vanno a influenzare la morfologia dei profili.

Quindi, alla fine, dopo tutte queste considerazioni, mi pare piuttosto evidente che un profilo di caratterizzazione non sia una mappa affidabile per stabilire la bontà di un sensore.

Ultima cosa... questo è la proiezione del locus del profilo della D850 e della 5dmk4; si tratta di un profilo intermedio particolare, lineare, privo di gamut compression e color correction :

Sono diversi, ma anche molto simili, molto più simili dei profili presenti in C1 che inglobano tutta quel resto di robe di cui vi ho parlato.

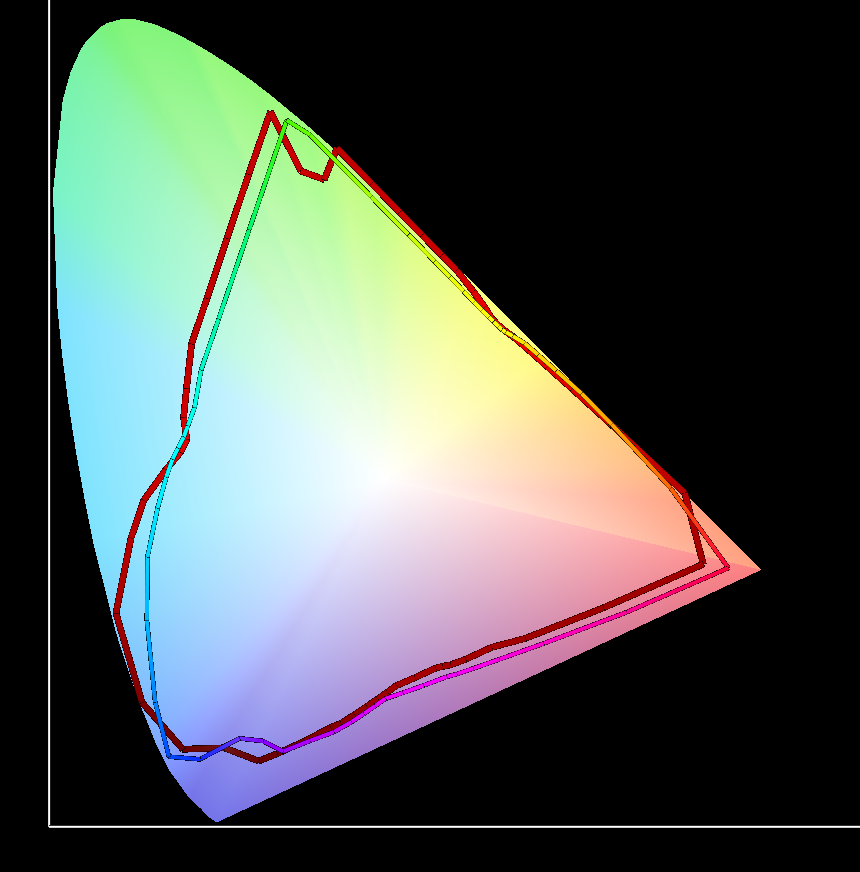

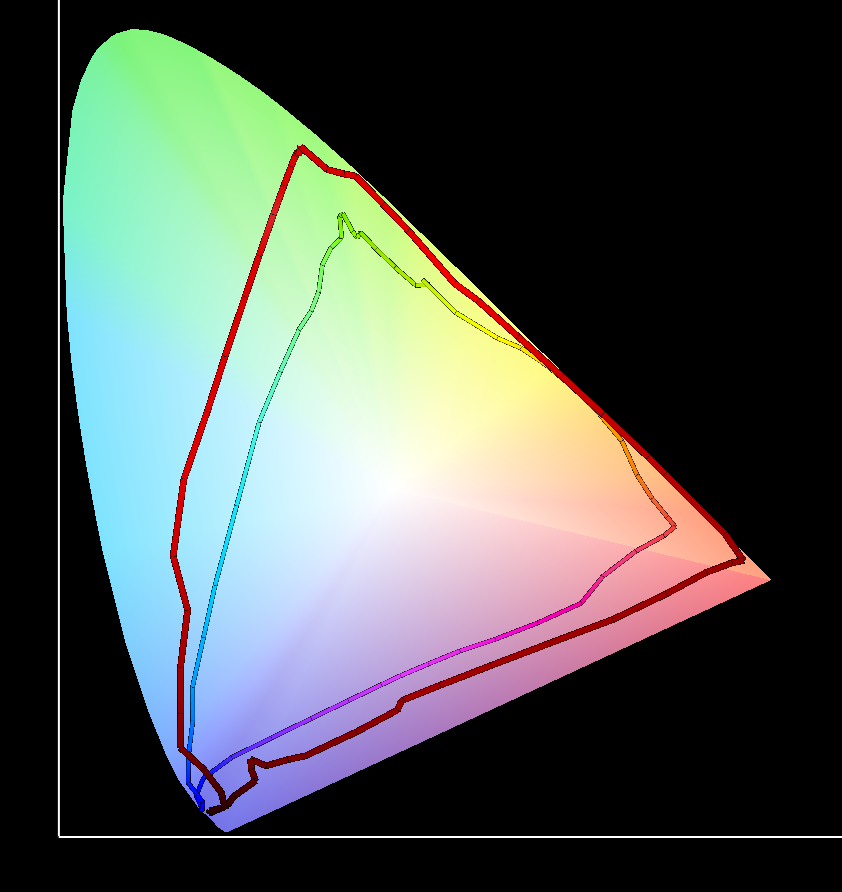

Ecco come si presentano quelli di C1:

In rosso 5dmk4 e colorato D850. E' palese che il profilo per la Nikon ha ricevuto un gamut compression più marcato.

Il perché e il percome non è dato sapere; ci sono troppe variabili nascoste.

L'unica cosa certa è che giudicare i sensori da questo tipo di confronti è un errore tecnico enorme.

Spero che finalmente sia chiaro..... |

|

|

inviato il 19 Gennaio 2018 ore 14:18

“ L'unica cosa certa è che giudicare i sensori da questo tipo di confronti è un errore tecnico enorme. „

Raamiel speriamo l'abbia capita  |

|

|

inviato il 19 Gennaio 2018 ore 14:51

“ L'unica cosa certa è che giudicare i sensori da questo tipo di confronti è un errore tecnico enorme.

Spero che finalmente sia chiaro..... „

Speriamo, anche perché è molto difficile che la differenza reale fra un sensore ed un altro sia nelle proporzioni che ci vuol mostrare Pollastrini, poi i sensori sulle Nikon quando mostrano di essere superiori li ha fatti la Sony, quando ci vuol far vedere una inferiorità abissale come quella di questi fenomenali profili, i sensori sono quelli delle NIKON...... |

user86191

|

inviato il 19 Gennaio 2018 ore 15:25

rento sempre dell'idea che la dicitura Senior in blu per Raamiel sia decisamente stretta per competenza e disponibilità nello spiegare

ma poi che me ne frega dei profili di C1 per le Nikon se devo installare il Cobalt per Df  |

|

|

inviato il 19 Gennaio 2018 ore 15:37

Concordo pienamente con Raamiel. I sensori non hanno un gamut. Non sono dei monitor |

|

|

inviato il 19 Gennaio 2018 ore 15:41

Quseta cosa dei colori dei vari brand o dei vari sensori ritorna ridondante ogni tot mesi.

Puntualmente arriva Raamiel e spiega le cose... Fra tre mesi tornerà di nuovo sto discorso.  |

|

|

inviato il 19 Gennaio 2018 ore 16:15

Raamiel, i tuoi post come sempre sono illuminanti, e ne avevi già fatti altri in merito, nel corso di precedenti sproloqui altrui. Come dicevo qualche post più sopra, però, secondo me non avrai grandi risultati da questa tua fatica: "a lavar la testa al ciuccio... ecc ecc " |

|

|

inviato il 19 Gennaio 2018 ore 16:31

“ I sensori non hanno un gamut; non è possibile definirne uno. „

Quindi i sensori per voi sono tutti uguali ?

A questo punto il sensore di una 20D sarebbe uguale ad un sensore della 5DIV ........ non hanno gamut quindi tutti uguali ........ nessuna differenza di sensibilità colore .................... è tutto il resto che cambia il colore ...............

Bah .....

|

Che cosa ne pensi di questo argomento?

Vuoi dire la tua? Per partecipare alla discussione iscriviti a JuzaPhoto, è semplice e gratuito!

Non solo: iscrivendoti potrai creare una tua pagina personale, pubblicare foto, ricevere commenti e sfruttare tutte le funzionalità di JuzaPhoto.

Con oltre 259000 iscritti, c'è spazio per tutti, dal principiante al professionista. |

Metti la tua pubblicità su JuzaPhoto (info) |

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.