|

|

inviato il 31 Maggio 2024 ore 0:25

L'ho letto giusto qualche giorno fa ma non ricordo la fonte, devo cercare nella cronologia del pc, il tempo di readout della a9iii è di 1/1250 di secondo, ovvero 0,0008 secondi, poco meno di un millesimo do secondo.

Il tempo di scatto non c'entra col readout, sono due fasi diverse |

|

|

inviato il 31 Maggio 2024 ore 0:55

“ nel gs il tempo di scatto è il tempo di lettura, il fatto che sia simultaneo non significa che non abbia un tempo misurabile, siamo nel campo della fisica non nel mondo di Harry Potter „

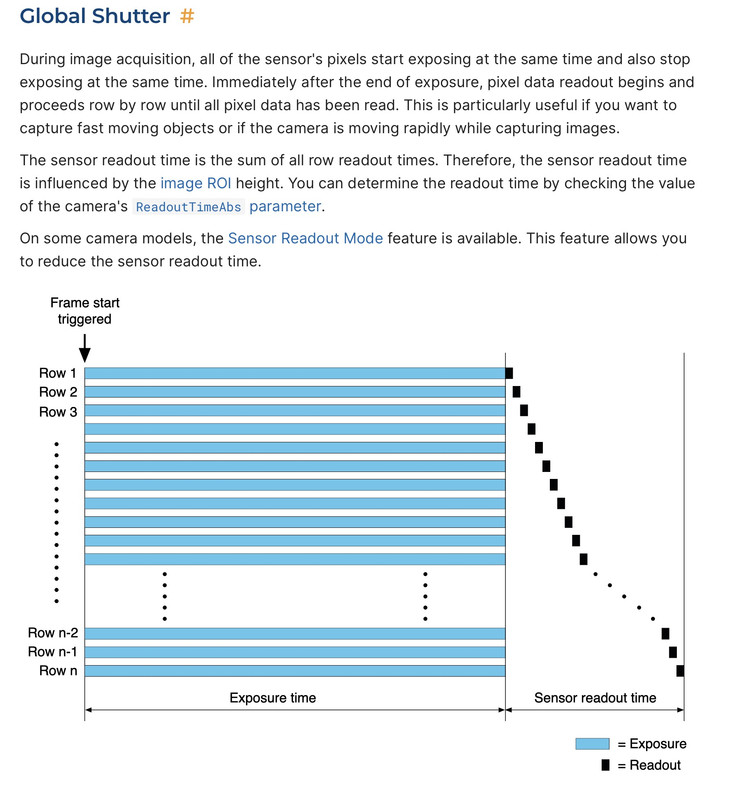

No, il tempo di lettura è il delta che c'è tra la lettura della prima riga di pixel e l'ultima, che nei CMOS sono solitamente lette in sequenza, non c'entra con il tempo di esposizione.

Su una macchina qualunque posso scattare a 1/4000s, significa che ogni pixel vedrà la luce per 1/4000s, ma ciò non implica che quei pixel siano esposti alla luce nello stesso istante. |

|

|

inviato il 31 Maggio 2024 ore 1:13

“

(tempo di "acquisizione") Ttot = Treadout + Twrite_buffer + Twrite_scheda

Sensore GS -> Treadout = 0 ("trascurabile", nel senso che la fisica da a questa parola cioè più piccolo dell'incertezza con cui misuro le altre grandezze in gioco).

Sensore RS -> Treadout = .... quelli che sappiamo

Per tutti i sensori

Fino a che il buffer ha spazio, non scrivo sulla scheda

quindi Twrite_scheda=0 e il tempo di "acquisizione" è Ttot= Treadout + Twrite_buffer.

Se ci interessa sapere come questo influenzi la raffica, possiamo dire che:

DeltaTmin_raffica = 1/fps_max > Ttot = Treadout + Twrite_buffer

cioè che l'intervallo di tempo minimo tra due frame deve per forza essere maggiore del tempo per "acquisire" uno di questi, pena la perdita di dati.

Se il buffe si riempie, la raffica deve per forza rallentare o fermarsi per il tempo necessario a svuotare il buffer per poi riprendere come prima. Tutto semplice.

In tutto questo, i tempi di esposizione non c'entrano nulla se non che, se voglio una raffica a 100fps, il tempo di esposizione t dovrà essere più breve del DeltaTraffica = 1/fps almeno del tempo necessario per "acquisire" un frame quindi t < DeltaTraffica + Ttot (supponendo che abbiamo ancora spazio nel buffer)

„

Concordo ed era quello che, in parte, avevo detto in precedenza.

@LorenzoP

avendo A1 e A7r5 conosco l'effetto del tempo di RO  Grazie comunque Grazie comunque

|

|

|

inviato il 31 Maggio 2024 ore 1:29

Scusate sto dal cell (ed è anche tardi) quindi sarò sintetico ma penso che sia importante fare un po' di chiarezza perché ho letto alcune imprecisioni dovute più che altro alla abitudine nella valutazione dei sensori rs.

Il readout su un rs equivale al tempo che intercorre tra la lettura della prima e dell'ultima riga (non esattamente…ma diciamo così) semplicemente perché come finisce la lettura della riga la questa viene convertita e trasmessa alla memoria, mentre la riga viene spenta e resettata.

Nel gs le righe sono lette tutte insieme ma il passaggio in memoria non avviene in tempo zero tutto insieme.

Tipicamente per un gs si può considerare il RO come la massima frequenza possibile in output, quindi nel caso di sony 120fps.

Questo ovviamente non è da considerare come tempo di scansione, perché come detto la scansione avviene nello stesso tempo per tutti i sensel e quindi righe, impedendo qualsiasi deformazione o differenza di esposizione. |

|

|

inviato il 31 Maggio 2024 ore 7:15

Mac credo proprio che all'atto pratico sia più veloce di 1/120, tendo a concordare sul tempo che ha dato Fuzy.

Ma di sicuro non coincide con il tempo di esposizione più veloce disponibile, quella è una fantasia.

Solo nel mondo di Harry Potter esiste una macchina GS che legge, traduce e immagazzina nelle memorie del sensore (non nel buffer) i valori della luce raccolta dai pixel esattamente nel medesimo tempo (o poco più) che ci mette a esporli col tempo più rapido disponibile (1/80000 nel caso in esame), senza aggiungere un fico secco in termini temporali a causa di ciò che viene immediatamente dopo l'esposizione.  |

|

|

inviato il 31 Maggio 2024 ore 7:20

Azzo ho riaperto il 3D chiedendo dove trovare quella tabella postata in prima pagina è mi ritrovo con tutti questi post, anche se alcuni utili, che hanno straripetuto il concetto di readout ma non del tempo di esposizione, specie nei GS.

... perlomeno da una lettera veloce così mi è sembrato  |

|

|

inviato il 31 Maggio 2024 ore 7:27

Esposizione è semplice Mario, è per quanto tempo il sensel raccoglie la luce, per quanto viene "riempito" dai fotoni. E quello è il tempo che decidi in macchina con la rotella, che viene attuato dall'elettronica dei sensel/gruppi di sensel (tutti insieme nel GS): nient'altro.

Poi dopo c'è la fase che traduce e immagazzina nelle memorie attinenti ai sensel (NON il buffer!) tale carica, e anche questa fase ha un tempo, che però non è parte di (né può coincidere con!) quello di esposizione: viene dopo, ed è certamente maggiore del tempo di otturazione minimo consentito dalla fotocamera (es. il famoso 1/80000), così come non può essere fisicamente più lento della maggiore velocità di raffica (anche considerando quella ad alta frequenza e con limitazioni di sorta) della fotocamera stessa - come anche ricordato in molti post precedenti (da MacTwin, Jakk, Maurizio, Bubu, Fuzy... tanta gente insomma).

Nei global shutter come ha scritto MacTwin si può anche considerare questo tempo come facente parte del readout, ma più per per comodità/convenzione, per non dire che sia proprio zero; anche se, secondo me, in relazione alla tabella iniziale, questo non sarebbe coerente, poiché in un Rolling Shutter come "readout" si intende la sola differenza temporale di lettura fra cima e fondo del sensore: non ciò che "ci sta dopo" (tantomeno prima, che è l'esposizione, di nuovo quel 1/80000).

E siccome questa differenza nel GS è zero, il readout - inteso alla maniera dei RS - per il GS possiamo tranquillamente dire che è zero, e scrivere in cima la A9III con un bello "0", nella tabella sopra.

Altrimenti, per coerenza con la tabella, ai tempi di readout di tutte le altre macchine dovremmo sommare quel qualcosa che corrisponde alle operazioni che "stanno dopo": operazioni che però, torno a dire, non sapremo mai quantificare con certezza, a meno che qualcuno non trovi il modo di misurarle per via strumentale o che qualche progettista delle varie case non si lasci scappare i dati tecnici (***) .

(***) sappiamo solo upper bound - raffica, di sicuro più veloce di 1/fps_max - e lower bound - esposizione minima, di sicuro molto più lento di essa. |

|

|

inviato il 31 Maggio 2024 ore 9:39

Black purtroppo non ho le specifiche, potrebbe anche fare di più ma non penso molto di più, anche se sono pochi mpx la quantità di dati è grande, forse e ripeto forse passa 240fps che l'elettronica gestisce al massimo a 120fps, ma sinceramente non credo minimamente a 1/1250...a meno che chi lo ha scritto ha riportato un'altra cosa....e anche 240fps incomincia ad essere tanta roba, ma Sony spesso stupisce, vedremo sui prossimi sensori quanti dati potrà gestire (dipendenti anche dalla velocità della memoria).

Come hai riportato non ha senso portarlo in tabella perché mentre su un RS è un indicatore utile a concepire i limiti dell'effetto RS (deformazione) ed il sync, su GS non ha nessuna valenza perché il sensore non soffre di nessuno di questi limiti.

|

|

|

inviato il 31 Maggio 2024 ore 9:45

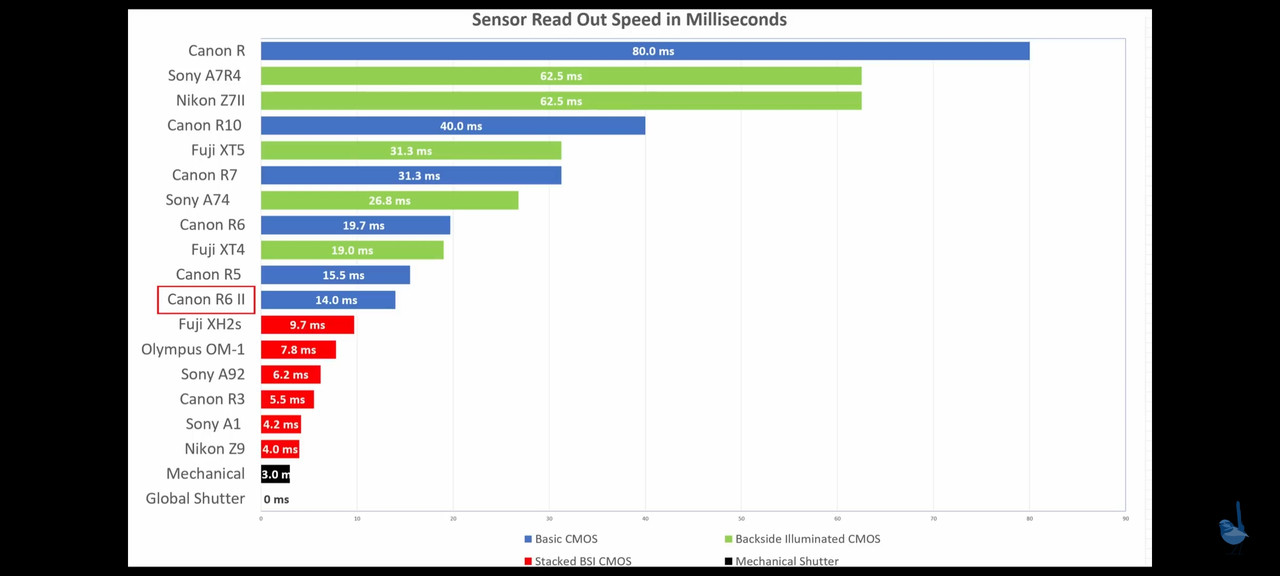

Però se e quando puoi correggi la R6 Mark II, è un po' lentina in quel modo...

@Fuzy

Se riesci a ritrovare la fonte di 1/1250, così leggiamo e verifichiamo il dato insieme... |

|

|

inviato il 31 Maggio 2024 ore 11:46

Se vi può servire, posto una tabella con il RO di vari modelli calcolati da Duade Paton, non è recentissima, se non ricordo male aggiornata al 2023, il GS viene riportato con valore 0 ms

|

|

|

inviato il 31 Maggio 2024 ore 12:09

Black corretto il foglio, non so come sia nato quell'errore...

Vito ripeto, se parliamo di scansione del sensore è un conto, il RO è quanto impiegano i dati ad essere portati in memoria, per ovvi motivi non può essere zero! perché i dati occupano banda e devono essere spostati verso la memoria.

|

|

|

inviato il 31 Maggio 2024 ore 12:18

Sapevo che il Read Out speed (velocità di lettura) è il tempo che impiega il processore a leggere l'immagine riga per riga dall'alto verso il baso, la differenza di tempo che impiega dal punto A al punto B, se eccessivo, può creare la deformazione dell'immagine acquisita, con zero ms, non ci può essere distorsione |

|

|

inviato il 31 Maggio 2024 ore 12:20

Si poi alla fine i concetti son quelli, basta mettersi d'accordo sul come chiamarli.  |

|

|

inviato il 31 Maggio 2024 ore 12:21

Ha ecco, pensavo di essermi perso qualcosa... |

|

|

inviato il 31 Maggio 2024 ore 12:31

Vito il concetto è quello, ma nel caso del RS questa operazione corrisponde anche al momento in cui viene letta la riga, nel GS no.

Il problema di quel grafico che hai postato è che molto probabilmente hanno calcolato il tempo usando un oscilloscopio o similare, in pratica hanno scattato misurando il tempo in cui una riga proiettata ad una certa frequenza veniva letta una sola volta.

Ma questo come detto a senso per i RS non per i GS, perché appunto porterebbe ad un valore di 0 che non è il reale valore di RO. |

|

Metti la tua pubblicità su JuzaPhoto (info) |

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.

JuzaPhoto contiene link affiliati Amazon ed Ebay e riceve una commissione in caso di acquisto attraverso link affiliati.